24.11.2025

GPT-OSS 120B auf dem AI Cube Pro: OpenAIs Open-Source-Modell lokal betreiben

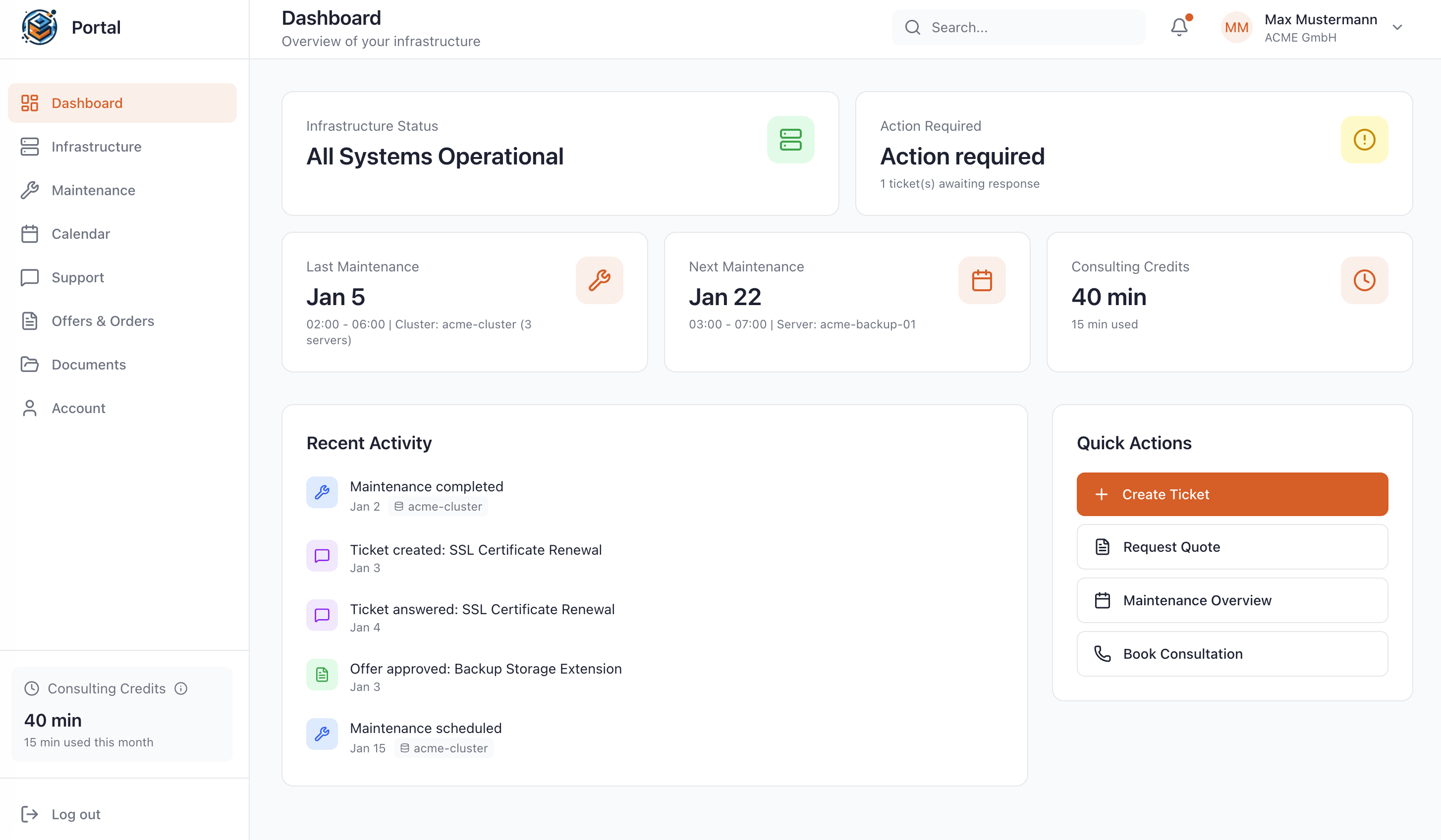

Mit GPT-OSS 120B hat OpenAI im August 2025 erstmals seit GPT-2 wieder ein Open-Weight-Modell veröffentlicht – und es ist beeindruckend. Das Modell erreicht nahezu die...