PrivateGPT

PrivateGPT ist eine production-ready AI-Lösung zum Chatten mit Ihren Dokumenten unter Verwendung von Large Language Models (LLMs). Die Plattform ist 100% privat - keine Daten verlassen Ihre Ausführungsumgebung. PrivateGPT bietet eine vollständige RAG-Pipeline (Retrieval Augmented Generation), eine FastAPI-basierte API mit OpenAI-Kompatibilität und unterstützt sowohl lokale als auch Remote-LLM-Provider.

Über PrivateGPT

PrivateGPT ist eine production-ready AI-Lösung zum Chatten mit Ihren Dokumenten unter Verwendung von Large Language Models (LLMs). Die Plattform ist 100% privat - keine Daten verlassen Ihre Ausführungsumgebung. PrivateGPT bietet eine vollständige RAG-Pipeline (Retrieval Augmented Generation), eine FastAPI-basierte API mit OpenAI-Kompatibilität und unterstützt sowohl lokale als auch Remote-LLM-Provider.

Mit PrivateGPT können Sie eine vollständig lokale AI-Lösung betreiben, die Dokumente intelligent verarbeitet, durchsucht und kontextbasierte Antworten liefert. Die Lösung unterstützt verschiedene LLM-Provider wie Ollama, LlamaCPP, OpenAI, Azure OpenAI und mehr - ideal für Unternehmen mit strengen Datenschutz- und Compliance-Anforderungen wie DSGVO, Gesundheitswesen oder Rechtsbereich.

WZ-IT & PrivateGPT

Wir installieren, hosten und betreiben PrivateGPT für Ihr Unternehmen - wahlweise vollständig on-premise in Ihrer eigenen Umgebung oder auf unserer sicheren, DSGVO-konformen Infrastruktur in Deutschland. Nutzen Sie die Vorteile privater KI mit vollständiger Datenkontrolle und ohne Vendor Lock-in.

Mit 24/7 Monitoring, Enterprise Support, automatisierten Backups und professioneller Wartung sorgen wir für höchste Verfügbarkeit und zuverlässigen Betrieb Ihrer PrivateGPT-Instanz. Inklusive Unterstützung bei der Integration Ihrer bevorzugten LLM-Provider, der Dokumenten-Ingestion und RAG-Optimierung.

100% Privatsphäre & Datenschutz

Keine Daten verlassen Ihre Ausführungsumgebung. Vollständige Datensouveränität für DSGVO-kritische Unternehmen, Behörden, Gesundheitswesen und regulierte Branchen.

Vollständige RAG-Pipeline

Production-ready RAG-Pipeline mit Dokumenten-Parsing, Splitting, Metadaten-Extraktion, Embedding-Generierung und kontextbasierter Chunk-Retrieval für präzise Antworten.

OpenAI API-kompatibel

FastAPI-basierte Architektur mit OpenAI-kompatibler API. Nahtlose Integration in bestehende Tools und Workflows ohne Änderungen an Ihrem Code.

Vollständig lokal betreibbar

Kann komplett offline und lokal betrieben werden - on-premise, in Ihrer Private Cloud oder Air-Gapped-Umgebung. Keine Abhängigkeit von externen Cloud-Diensten.

Flexible LLM-Provider-Unterstützung

Unterstützt lokale Provider (Ollama, LlamaCPP) und Remote-Provider (OpenAI, Azure OpenAI, Sagemaker, etc.). Wechseln Sie flexibel zwischen verschiedenen Modellen.

Intelligente Dokumenten-Ingestion

Automatische Dokumentenverarbeitung mit Parsing, Chunking, Metadaten-Extraktion und Embedding-Generierung für optimale RAG-Performance und Suchergebnisse.

Volle Datensouveränität

Alle Daten bleiben unter Ihrer Kontrolle. Perfekt für DSGVO-Compliance, vertrauliche Unternehmensdaten, Patientenakten, Rechtsdokumente und sensible Informationen.

100% Open Source

PrivateGPT ist vollständig open source (Apache-2.0 Lizenz) und ermöglicht komplette Transparenz, Sicherheitsaudits und Anpassungen nach Ihren spezifischen Anforderungen.

Kein Vendor Lock-in

Basiert auf LlamaIndex Framework. Freie Wahl zwischen verschiedenen LLM-Providern, Vektordatenbanken und Deployment-Modellen ohne Abhängigkeit von einzelnen Anbietern.

PrivateGPT Installation & Einrichtung

Professionelle Installation auf Ihrer Infrastruktur – On-Premise, Cloud oder Hybrid

On-Premise

In Ihrem Rechenzentrum

- Installation auf Bare-Metal, VM oder Docker

- Optimale Performance-Konfiguration

- Integration in bestehendes Active Directory/LDAP

- SSL-Zertifikat & Reverse Proxy

- Backup-Strategie & Monitoring

- Security Hardening nach Best Practices

- Dokumentation & Schulung

Cloud Installation

AWS, Azure, Hetzner & Co.

- Installation auf AWS, Azure, GCP, Hetzner

- Terraform/IaC Setup (optional)

- Kubernetes oder Docker Compose

- Auto-Scaling Konfiguration

- Load Balancer & CDN Integration

- CloudWatch/Monitoring Setup

- Cost Optimization & Best Practices

Enterprise Setup

High-Availability Setup mit umfassenden Security- und Compliance-Features

- High-Availability Cluster Setup

- VPN-Zugang (z.B. WireGuard, NetBird, Tailscale)

- SSO Integration (z.B. Keycloak, Authentik, Azure AD)

- Multi-Faktor-Authentifizierung (MFA)

- Audit Logging & Compliance

- Disaster Recovery Plan

- Individuelle Security Policies

- Dedizierter Ansprechpartner

Perfekt für diese Anwendungsfälle

privategpt_usecase_1_title

privategpt_usecase_1_desc

privategpt_usecase_2_title

privategpt_usecase_2_desc

privategpt_usecase_3_title

privategpt_usecase_3_desc

privategpt_usecase_4_title

privategpt_usecase_4_desc

privategpt_usecase_5_title

privategpt_usecase_5_desc

privategpt_usecase_6_title

privategpt_usecase_6_desc

Security & Secure Access

Sichere Einwahl und Zugriffskontrolle für Ihre Installation

VPN-Zugang

WireGuard, NetBird oder Tailscale

SSO Integration

Keycloak, Authentik, Azure AD

Multi-Faktor-Auth

TOTP, WebAuthn, YubiKey

Firewall & Hardening

Fail2Ban, Rate Limiting, IP Whitelisting

Sichere Einwahl via VPN

Wir richten für Sie einen sicheren VPN-Zugang zu Ihrer Installation ein – ideal für Remote-Work und externe Mitarbeiter.

- Zero-Trust Network Access (ZTNA)

- Verschlüsselte Verbindungen

- Einfaches Client-Setup für alle Geräte

- Zentrale Zugriffsverwaltung

Unterstützte VPN-Lösungen:

Das ist im Service enthalten

Full-Service Installation ohne versteckte Kosten

PrivateGPT Entwicklung & Integration

PrivateGPT ermöglicht lokale LLM-Nutzung mit eigenen Dokumenten. Wir integrieren es in Ihre bestehende Infrastruktur und erweitern die Fähigkeiten.

REST API

Über die API binden wir PrivateGPT an Ihre Systeme an: Chat-Completion, Document Ingest, und Context-Retrieval lassen sich programmatisch steuern.

Document Processing

Wir entwickeln Custom Ingestion Pipelines: Spezielle Dokumenttypen (CAD, Verträge, Code) werden mit optimierten Chunking-Strategien verarbeitet.

LlamaIndex Extensions

Das LlamaIndex-Backend erlaubt tiefe Anpassungen: Custom Retrievers, Reranker, und Embedding-Modelle für domänenspezifische Suche.

Konkrete Use Cases

So setzen wir PrivateGPT-Entwicklung in der Praxis um.

Air-Gapped Deployment

Hochsensible Umgebungen (Behörden, Verteidigung) dürfen keine Cloud-Verbindung haben, brauchen aber LLM-Fähigkeiten.

Vollständig offline-fähiges Setup mit lokalen Modellen, eigenen Embeddings, und airgapped Update-Mechanismen.

Legal Document Discovery

Anwälte müssen tausende Dokumente nach relevanten Passagen durchsuchen. Manuelle Sichtung dauert Wochen.

PrivateGPT mit juristisch optimiertem Chunking und Retrieval. Fragen in natürlicher Sprache, Antworten mit Quellennachweis.

E-Mail Assistent

Führungskräfte bekommen hunderte E-Mails täglich. Zusammenfassungen und Priorisierung werden benötigt.

PrivateGPT-Integration, die E-Mails analysiert, zusammenfasst, und nach Dringlichkeit kategorisiert – vollständig on-premise.

Enterprise Managed Hosting

Enterprise Grade

Open-Source enterprise-fähig für Produktions-Workloads - wir betreiben Ihre Anwendungen mit höchsten Sicherheitsstandards und Enterprise Support

Warum Enterprise Managed Hosting?

Open Source Software für geschäftskritische Prozesse erfordert professionelle Wartung, kontinuierliche Updates und enterprise-grade Support. Mit unserem PrivateGPT Enterprise Managed Hosting erhalten Sie die notwendige Infrastruktur und Betreuung, um Open Source zuverlässig in Produktionsumgebungen zu betreiben. Backups, SLAs, telefonischen Support und persönlichem Ansprechpartner - damit Sie sich auf Ihr Kerngeschäft konzentrieren können.

Installation auf Ihrer Infrastruktur

Individuelle Lösung gewünscht?

Wir bieten auch maßgeschneiderte PrivateGPT Enterprise Lösungen für Ihre speziellen Anforderungen. Kontaktieren Sie uns für ein individuelles Angebot.

Die perfekte Hardware für Ihre KI-Anwendungen

Von vollständig verwalteten GPU-Servern bis hin zu kompakten AI Cubes – wir bieten die ideale Infrastruktur für Ihre lokalen LLM-Anwendungen.

Managed GPU Server

Leistungsstarke GPU-Server mit dedizierter Hardware für rechenintensive LLM-Workloads. Vollständig verwaltet, skalierbar und optimiert für maximale Performance.

- NVIDIA RTX GPUs

- 24/7 Monitoring & Support

- Flexible Skalierung nach Bedarf

- Europäisches Hosting (DSGVO-konform)

AI Cube

Kompakte KI-Workstation für lokale LLM-Inferenz. Perfekt für Büroumgebungen, mit erstklassiger Performance und absoluter Datensouveränität.

- NVIDIA RTX GPUs

- 100% lokale Datenverarbeitung

- Plug & Play Setup

- Ideal für Kanzleien & Büros

Sie interessieren sich für PrivateGPT?

Gut gewählt – wir helfen Ihnen beim Start oder beim Betrieb.

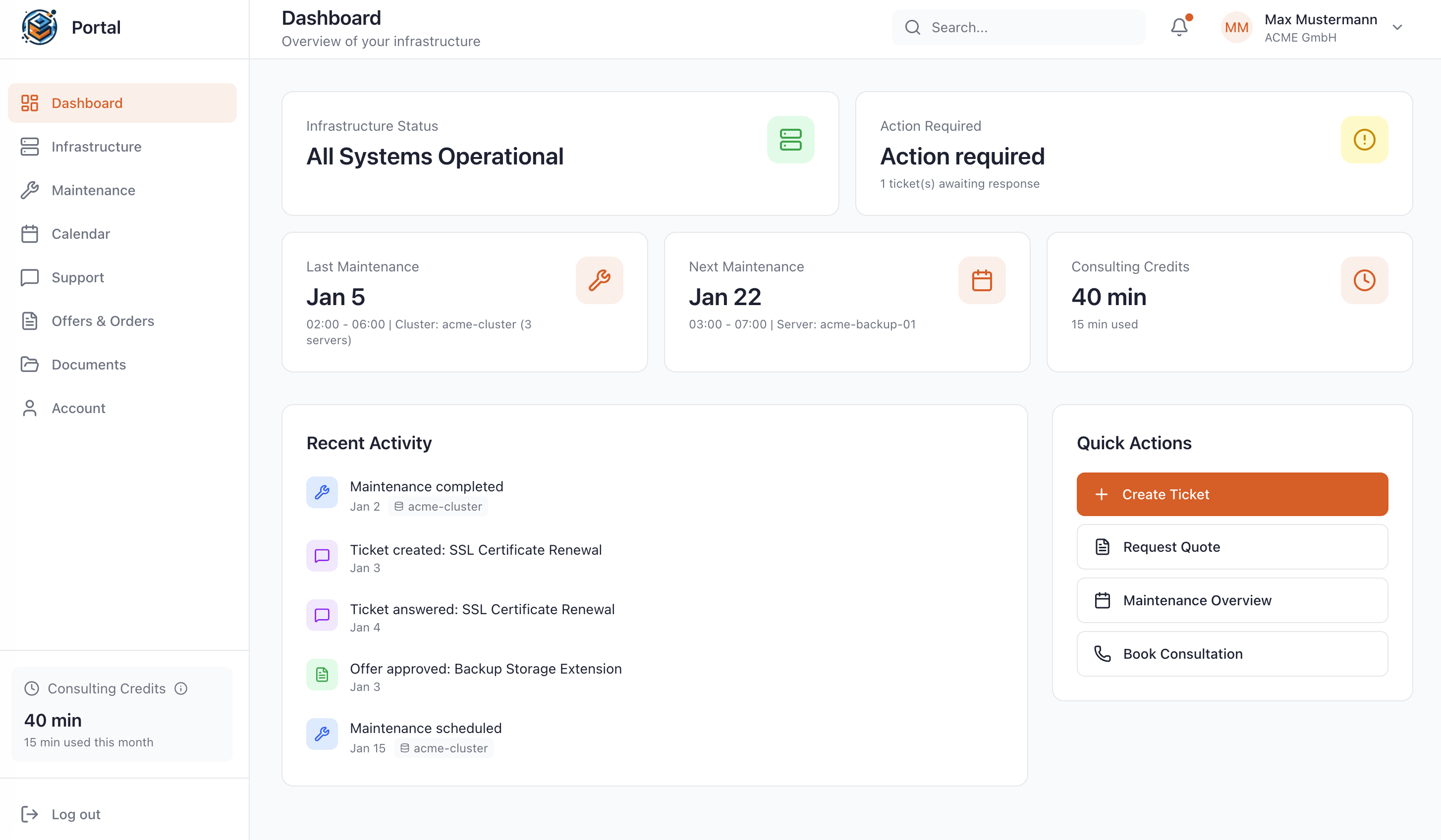

Verwalten Sie Ihren Stack im Kunden-Portal

Als Kunde eines Managed Services bei WZ-IT haben Sie Zugriff auf unser exklusives Portal: Überwachen Sie Ihre Infrastruktur in Echtzeit, planen Sie Wartungen, fordern Sie Angebote an und erhalten Sie direkten Support – alles zentral an einem Ort.

- Live-Infrastruktur-Status in Echtzeit

- Wartungsfenster selbst verschieben

- Komplette Zugriffsprotokolle einsehen

- Direkter Support ohne Umwege

Lassen Sie uns über Ihre Idee sprechen

Ob konkrete IT-Herausforderung oder einfach eine Idee – wir freuen uns auf den Austausch. In einem kurzen Gespräch prüfen wir gemeinsam, ob und wie Ihr Projekt zu WZ-IT passt.

Timo Wevelsiep & Robin Zins

Geschäftsführer